Machine Learning, redes neurais, Deep Learning são conceitos que levam muitos a pensar em Ciência da Computação, certo? Embora haja essa correlação, o que há de mais profundo na revolução que o mundo está presenciando com a Inteligência Artificial (IA) são avanços fundamentados na Física e na Matemática, que estabeleceram as bases da tecnologia atual. Essa é a essência do anúncio dos Prêmios Nobel de Física e Química, concedidos pela Academia Real das Ciências da Suécia nos dias 8 e 9 de outubro, respectivamente, na opinião de dois professores consultados pelo Boletim SBF. Nestor Caticha, professor de Física Estatística do Instituto de Física da Universidade de São Paulo (IFUSP), também escreveu um texto para sua instituição destacando a necessidade de ampliar a visão acadêmica sobre a disciplina.

“O Prêmio Nobel de Física deste ano demonstra mais uma vez a importância do investimento em ciência básica. Desenvolvimentos realizados em Física básica na década de 1980, especificamente no estudo de modelos matemáticos de redes neurais, possibilitaram a revolução que hoje vivenciamos na sociedade moderna com a IA. O caminho desde a descoberta científica até a sua aplicação é muitas vezes imprevisível e cheio de percalços, mas a necessidade dos investimentos em ciência básica é o que vai permitir que a tecnologia avance no futuro”, diz Rodrigo Capaz, presidente da Sociedade Brasileira de Física (SBF).

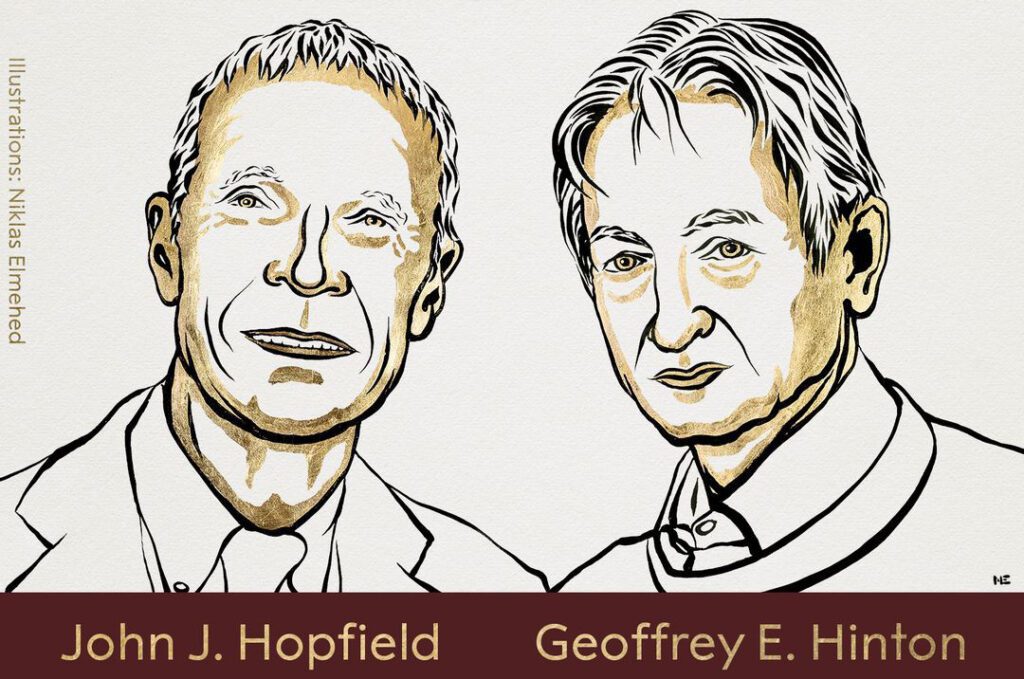

Neste ano, o Prêmio Nobel de Física foi concedido a John J. Hopfield e Geoffrey E. Hinton por suas contribuições fundamentais que permitiram o desenvolvimento do aprendizado de máquina com redes neurais artificiais. A pesquisa de ambos ajudou a moldar os alicerces da inteligência artificial (IA) moderna, impactando não só a Física, mas também uma vasta gama de áreas tecnológicas e científicas. Já o Nobel de Química foi concedido a David Baker, Demis Hassabis e John M. Jumper pelos estudos sobre as estruturas de proteínas do nosso corpo por meio da IA. Hassabis foi cofundador da DeepMind em 2010, empresa adquirida pela Alphabet em 2014, hoje CEO da divisão da IA do Google, um dos criadores do AlphaGo, sistema de IA que foi treinado para jogar xadrez, e do AlphaFold, que atuou na pesquisa das proteínas.

“Os prêmios em si têm grande relevância. Mas é preciso ressaltar a importância do conhecimento básico de Física que levaram a essas descobertas, que possibilitaram a criação dos instrumentos de Matemática e de modelos da Física que podem ser aplicados a qualquer área. E isso explica por que você tem físico trabalhando em áreas tão diferentes: porque os construtos essenciais para fazer ciência de qualidade estão muito presentes na formação que a gente tem de Física”, afirma o físico Osvaldo Novais de Oliveira Junior, professor do Instituto de Física de São Carlos (IFSC/USP) e um dos criadores do Núcleo Interinstitucional de Linguística Computacional (NILC).

“Com certeza a gente pode enxergar que uma série desses avanços do que a gente chama agora de inteligência artificial estão fundamentados em conceitos matemáticos, perspectivas matemáticas que também foram desenvolvidas na Física”, concorda o físico Henrique Ferreira dos Santos, professor de IA da Faculdade de Informática e Administração Paulista (FIAP) e doutorando em nanociência e materiais avançados na Universidade Federal do ABC (UFABC).

Com o surgimento dos computadores, desde a década de 1950, os cientistas buscavam meios para aproximar a máquina do raciocínio humano, lembra Oliveira Junior. “Inclusive o computador, por um tempo, era chamado de cérebro eletrônico: já havia a intenção de um dia fazer com que a máquina pudesse também realizar atividades intelectuais como os humanos”, lembra o cientista, acrescentando que o ideal era processar a fala humana. “E você começa a olhar o pessoal da área de Física, que estava interessado em outras coisas, não só em computação, aliás em utilizar conceitos de física para diversas aplicações. Há algumas coisas que são fundamentais da Física e da Matemática: se você tem dois problemas que podem ser formulados segundo o mesmo modelo matemático, mesmo que os problemas sejam muito diferentes, eles vão ter a mesma solução”, explica.

Hopfield buscou aplicar o seu conhecimento em Física e na Biologia, sobre o funcionamento do sistema nervoso por meio de neurônios, e o uniu à ideia do spin eletrônico da Física, criando uma rede, cujos nós são “neurônios”, capazes de armazenar imagens e recuperar informação. E, como dados são dados, ele criou os primórdios da IA, dando os primeiros passos a caminho do aprendizado de máquina, em 1982. Hinton, professor na Universidade de Toronto, expandiu o trabalho de Hopfield usando princípios da Física Estatística a fim de analisar um grande número de nós da rede neural. “Você tem inteligência artificial para tudo hoje, porque depois que você conseguiu fazer processamento em grande escala com as redes neurais, eu consigo reproduzir muitas informações de qualquer área. Então, você pode aplicar inteligência artificial para qualquer área, da economia à biologia”, diz Oliveira Júnior.

“Hopfield surpreendeu ao trazer a uma realidade concreta, onde a matemática permite descrever cuidadosamente aspectos da natureza do funcionamento do cérebro (ou modelos muito simplificados), sonhos de cientistas e filósofos, que especularam sobre a natureza do que somos, do que sentimos, de como pensamos. Trabalhos podem ser considerados importantes por diversas razões. A avalanche de perguntas e ideias que o trabalho de Hopfield desencadeou transformou não só o que pensamos sobre a área de atuação da Física, mas a própria sociedade em que vivemos”, afirma o professor Caticha.

Ferreira dos Santos lembra, inclusive, que as primeiras versões da rede de Hopfield caíram em desuso nas aplicações atuais, mas ele explica que, em artigos recentes, cientistas demonstraram como usar redes de Hopfield para implementar mecanismos de atenção como nas redes Transformer, criadas pelo Google a partir de 2017, e que estão por trás de IA generativas como chatGPT, Gemini e Copilot, o que demonstra a generalidade dos conceitos propostos por Hopfield 35 anos antes. O cientista da UFABC cita o cientista Freeman Dyson, para quem “as revoluções científicas podem ser causadas tanto por novos conceitos quanto por novos artefatos”. De acordo com Ferreira dos Santos, novos artefatos “normalmente nos fazem enxergar coisas novas, que precisam de novas explicações, enquanto novos conceitos são uma forma explicar a mesma coisa de maneira diferente”.

“O que eu acho interessante na área de inteligência artificial é que é uma revolução em ambos os sentidos. É uma revolução de artefato, que vai nos permitir enxergar coisas que nós não enxergávamos antes, e ela também é uma revolução de conceito, que vai permitir que a gente explique coisas que já sabíamos, mas de maneiras diferentes”, explica ele, que acredita que a forte presença da IA na sociedade, impulsionada por empresas privadas, deve estimular um debate profundo sobre o impacto social dessas tecnologias. Não à toa, Hinton deixou o Google por avaliar necessário maior debate sobre a influência dessa tecnologia.

Sem dúvida, o debate é extremamente relevante e, enquanto a sociedade busca se organizar para conviver com essa nova tecnologia, o professor Oliveira Junior reafirma a importância de os alunos aprenderem os conceitos básicos da Física. “Se os modelos que explicam o fenômeno são fenômenos completamente distantes, mas se o modelo é o mesmo, a solução tem que ser a mesma. Então, veja que isso é uma coisa, por exemplo, que é muito instigante quando nós ensinamos os alunos. A gente diz: olha, aprenda isso aqui que é fundamental, porque isso pode servir não só para aquilo que você está fazendo na sua disciplina, mas para muitas outras coisas para o resto da sua vida.”

Segundo o professor do IFUSP, a humanidade começa a entender a informação em níveis quânticos e entre neurônios biológicos ou artificiais, além da relação entre indivíduos e instituições. “As leis de Coulomb para estes sistemas estão esperando que vocês (estudantes) as descubram. No fim, entender as propriedades e limitações de sistemas de processamento de informação, nos ajudará a entender a natureza e os limites desse entendimento. Será isso Física ou não? Quem se importa? A física é sobre o que podemos dizer da natureza usando as ferramentas disponíveis, nossos cérebros e as máquinas artificiais, e para estas, as contribuições de Hopfield e Hinton, que não é tecnicamente um físico, mas pensa como se fosse, foram marcantes, numa trajetória de uma aventura que ainda não sabemos onde nos levará”, escreve Caticha para o Boletim do IFUSP.

(Colaborou Roger Marzochi)